Embedded ethics : et si des éthiciens rejoignaient les équipes qui développent vos outils IA ?

Une équipe de Munich propose d'intégrer des éthiciens directement dans les équipes de développement d'IA médicale. L'idée est séduisante — mais est-elle suffisante ? Décryptage d'une approche qui concerne directement les futurs outils de psychothérapie assistée par IA.

Source analysée

https://pubmed.ncbi.nlm.nih.gov/35081955/Le problème de départ

Depuis 2018, plus de 84 chartes éthiques pour l’IA ont été publiées par des organisations publiques et privées dans le monde. Toutes convergent vers des principes familiers issus de la bioéthique médicale (Beauchamp & Childress, 1979). Mais que signifient concrètement ces principes ?

Bienfaisance

Agir activement pour le bien du patient. Pour l’IA en santé mentale : l’outil doit produire un bénéfice clinique démontré, pas seulement « ne pas nuire ». Un chatbot thérapeutique qui occupe le patient sans améliorer son état ne remplit pas ce critère, même s’il ne cause pas de dommage.

Non-malfaisance

Ne pas nuire — primum non nocere. En IA : éviter les biais discriminatoires, les erreurs de diagnostic, les faux négatifs sur le risque suicidaire. Plus subtilement : ne pas créer de dépendance à l’outil, ne pas retarder l’accès à un vrai thérapeute. La nuisance peut être indirecte et invisible.

Transparence

Rendre visibles et compréhensibles les mécanismes de décision. Pour l’IA : le patient sait-il qu’il interagit avec une machine ? Comment l’algorithme détermine-t-il ses réponses ? Sur quelles données a-t-il été entraîné ? La transparence est le socle du consentement éclairé — sans elle, le patient ne peut pas choisir.

Justice

Assurer un accès équitable et une absence de discrimination. Pour l’IA : l’outil fonctionne-t-il aussi bien pour les populations sous-représentées dans les données d’entraînement ? Un algorithme de scoring de risque suicidaire entraîné principalement sur des populations blanches anglophones discrimine structurellement les minorités.

Responsabilité

Pouvoir identifier qui répond des conséquences. Pour l’IA : quand un chatbot donne un conseil inadapté à un patient en crise, qui est responsable ? Le développeur ? L’entreprise ? Le clinicien qui a recommandé l’app ? L’absence de chaîne de responsabilité claire est l’un des points aveugles les plus préoccupants.

Le problème ? Ces principes restent lettre morte dans les équipes de développement.

Les développeurs d’IA ne sont pas formés à l’éthique. Les éthiciens ne travaillent pas dans les entreprises tech. Et quand des lignes directrices existent, personne ne sait concrètement comment les appliquer dans le code, dans l’interface, dans les choix d’architecture. Brent Mittelstadt, chercheur à Oxford, a résumé le problème en 2019 : le développement IA n’a ni objectifs partagés, ni normes professionnelles, ni méthodes de traduction des principes en pratique, ni mécanismes de responsabilité.

Résultat : les patients deviennent parfois des « cobayes involontaires », comme l’a montré le cas d’un algorithme utilisé sur des millions de patients américains et qui s’est révélé porteur d’un biais racial significatif (Obermeyer et al., 2019).

C’est dans ce contexte qu’une équipe interdisciplinaire de la Technical University of Munich (TUM) propose une solution concrète : l’embedded ethics.

L’embedded ethics en 3 minutes

Le concept

L’embedded ethics (« éthique intégrée ») consiste à placer un ou plusieurs éthiciens directement dans l’équipe de développement, dès le début du projet et jusqu’à son déploiement. L’éthicien n’intervient pas ponctuellement, en comité d’éthique, après coup. Il participe aux réunions d’équipe, co-rédige les protocoles, analyse les choix de design au fil de l’eau.

Ce n’est pas un audit. C’est une collaboration continue.

Ce que ce n’est pas

| Approche | Quand ? | Qui ? | Limite |

|---|---|---|---|

| Chartes éthiques | Avant le projet | Direction / politique | Trop abstrait pour le développeur |

| Comité d’éthique | Après le design | Experts externes | Trop tard pour changer le produit |

| Formation éthique | Pendant les études | Enseignants | Insuffisant pour l’expertise requise |

| Embedded ethics | Tout au long du projet | Éthicien dans l’équipe | Dépend des rapports de pouvoir |

Les 9 recommandations concrètes

L’article propose une table de guidance que tout développeur d’outil de santé mentale devrait connaître :

Objectifs

Anticiper, identifier et adresser les enjeux éthiques à chaque phase du développement

Travailler de manière collaborative et itérative avec l’équipe technique

Intégration

Organiser des échanges réguliers, formels ou informels, entre éthiciens et développeurs

Pratique

Rendre explicites les cadres théoriques éthiques utilisés dans les analyses

Justifier les positions éthiques en lien avec les objectifs spécifiques du projet

Établir clairement la structure de prise de décision dès le début

Rendre transparentes les analyses éthiques, dans les limites de la confidentialité

Expertise et formation

L’éthicien intégré doit avoir une expertise en analyse éthique ET une compréhension de base de la technologie

Créer des opportunités de formation croisée avant et pendant le projet

Un cas concret qui existe déjà

L’approche n’est pas purement théorique. Depuis 2006, la bioéthicienne Jeantine Lunshof est intégrée à temps plein dans le laboratoire de George Church au Wyss Institute de Harvard (génomique, biologie synthétique). Elle participe aux réunions de labo, co-signe des publications, contribue à la rédaction des protocoles de recherche.

Ce modèle a été adapté pour l’enseignement : le programme Embedded EthiCS de Harvard intègre des philosophes dans les cours d’informatique — pas comme intervenants ponctuels, mais comme co-enseignants tout au long du semestre.

Le cas Anthropic. L’entreprise qui développe Claude (l’IA que nous utilisons pour ce site) emploie depuis 2021 Amanda Askell, philosophe titulaire d’un PhD de NYU en éthique, pour diriger l’équipe « personality alignment ». Son rôle : définir le caractère, les valeurs et les limites morales du modèle — non pas après coup, mais dès la conception. C’est une forme d’embedded ethics appliquée au développement d’IA conversationnelle. Askell a été nommée dans le TIME100 AI (2024) et profilée par le Wall Street Journal Magazine (février 2026) pour ce travail. Preuve que le modèle est pris au sérieux — au moins par certains acteurs.

La question clé : ces modèles, développés en génomique, en enseignement et chez certains développeurs d’IA, peuvent-ils se généraliser au développement d’IA médicale — un environnement soumis à une pression commerciale intense et où les enjeux pour les patients sont directs ?

Ce que ça change pour la psychothérapie

Pourquoi ça nous concerne directement

Les outils d’IA en santé mentale se multiplient : chatbots thérapeutiques, transcription de séances, analyse de sentiment, scoring de risque suicidaire, applications de suivi inter-séances. Chacun de ces outils est développé par des équipes techniques qui, le plus souvent, n’ont aucun psychologue clinicien dans leur équipe de développement, et encore moins d’éthicien.

Les décisions prises au stade du design déterminent le produit final :

| Décision technique | Enjeu éthique invisible | Conséquence clinique |

|---|---|---|

| Choisir les données d’entraînement | Quelles populations sont représentées ? | Biais dans la détection de la souffrance chez certaines cultures |

| Définir les seuils d’alerte suicide | Sensibilité vs. spécificité | Faux positifs anxiogènes ou faux négatifs dangereux |

| Concevoir l’interface du chatbot | Niveau de « chaleur » artificielle | Risque d’attachement problématique |

| Stocker les transcriptions | Durée, localisation, accès | Confidentialité du contenu thérapeutique |

Chacune de ces décisions est prise avant que le premier patient n’utilise l’outil. C’est exactement le moment où un éthicien intégré pourrait intervenir.

Le modèle idéal pour un outil IA-Psy

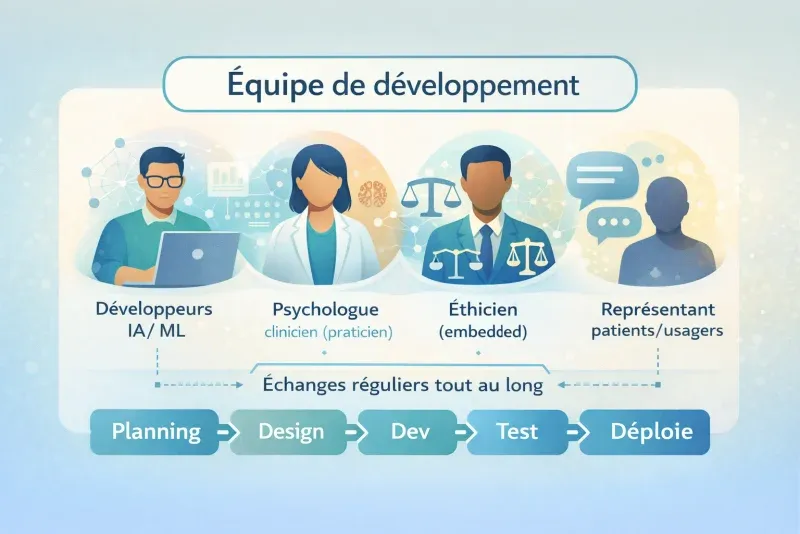

Si l’on appliquait l’embedded ethics au développement d’un outil d’IA pour la psychothérapie, l’équipe ressemblerait à ceci :

Dans ce modèle, l’éthicien n’est pas là pour bloquer ou valider. Il est là pour rendre visibles les enjeux que personne d’autre ne voit — parce que les développeurs n’ont pas la formation pour les repérer, et que les cliniciens n’ont pas accès au processus de développement.

Ce qui est solide dans cette proposition

Le diagnostic est juste

Les principes éthiques abstraits ne se traduisent pas spontanément en pratiques de développement. Ce constat est largement partagé dans la littérature académique.

Un cadre opérationnalisable

Les 9 recommandations sont concrètes, applicables et adaptables à différents contextes de développement.

Honnêteté intellectuelle

Les auteurs discutent eux-mêmes le risque d’ethics washing, les rapports de pouvoir, et la nécessité de mesures contraignantes. C’est rare dans ce type de littérature.

L’équipe exemplifie ce qu’elle prône

6 co-auteurs de disciplines différentes (éthique médicale, anthropologie, philosophie, sociologie des sciences, robotique). Ce n’est pas un éthicien qui parle seul — c’est une équipe interdisciplinaire qui a pratiqué ce qu’elle recommande.

Les limites — et pourquoi elles comptent

Aucune preuve que ça marche

C’est le point le plus gênant. L’article est une proposition, pas une évaluation. Aucune donnée empirique ne montre que l’embedded ethics produit de meilleurs outils, moins de dommages, ou de meilleures décisions éthiques. Le seul cas cité (Lunshof/Harvard) concerne la génomique, pas l’IA médicale.

Analogie clinique : c’est comme si un collègue proposait une nouvelle approche thérapeutique en disant « voici le protocole, mais nous n’avons aucune donnée d’efficacité ». On l’écouterait — mais on n’adopterait pas l’approche sans évaluation.

Le problème des rapports de pouvoir

Les auteurs eux-mêmes mentionnent le cas de Timnit Gebru, chercheuse en éthique de l’IA licenciée par Google après avoir publié des résultats critiques. Mais ils n’en tirent pas les conséquences pour leur propre proposition.

La question inconfortable : Que se passe-t-il quand l’éthicien intégré identifie un problème qui coûterait des millions à résoudre — ou qui remettrait en cause le produit lui-même ? A-t-il un droit de veto ? Peut-il publier ses conclusions ? Peut-il démissionner sans clause de non-divulgation ?

Sans mécanismes structurels de protection, l’éthicien intégré risque la capture cognitive : à force de travailler avec l’équipe, il finit par adopter sa culture et perdre son regard critique. Tout clinicien connaît ce phénomène — c’est exactement pourquoi la supervision est obligatoire en psychothérapie.

L’éthique importée plutôt qu’émergente

Le modèle repose sur l’idée que la compétence éthique est un savoir spécialisé détenu par des experts et qu’il faut l’importer dans les équipes techniques.

On peut concevoir les choses autrement. Si l’on pensait en termes d’écosystème — développeurs, cliniciens, patients, régulateurs en interaction constante — la compétence éthique pourrait émerger de ces interactions plutôt que d’être importée par un spécialiste. C’est la différence entre ajouter un ingrédient à une recette et créer les conditions pour qu’une saveur se développe d’elle-même.

L’angle mort de l’éthique du care

C’est peut-être l’absence la plus surprenante. Dans un article sur l’éthique de l’IA médicale, l’éthique du care n’est jamais mentionnée. Qu’est-ce que c’est ? Développée par Carol Gilligan (1982) puis formalisée par la philosophe politique Joan Tronto (1993), l’éthique du care est un courant moral qui place la relation de soin — et non les principes abstraits — au centre de la réflexion éthique. Là où le principisme (Beauchamp & Childress) demande « quels principes s’appliquent ici ? », l’éthique du care demande « de quoi cette personne vulnérable a-t-elle besoin, et comment y répondre de manière attentive et compétente ? »

Tronto identifie quatre phases du care : l’attention (caring about — reconnaître qu’un besoin existe), la prise en charge (taking care of — assumer la responsabilité d’y répondre), le soin effectif (care-giving — la compétence concrète dans l’acte) et la réception du soin (care-receiving — vérifier que le besoin a bien été satisfait, du point de vue du bénéficiaire). Ce cadre est directement pertinent pour le design d’outils IA en santé mentale.

Exemple concret :

Imaginons un chatbot de suivi inter-séances pour patients dépressifs. Avec une approche principiste, l’évaluation éthique vérifiera : le consentement est-il éclairé ? Les données sont-elles protégées ? L’outil est-il équitable ? Avec une approche care, on demandera en plus : le chatbot détecte-t-il quand l’utilisateur est en souffrance accrue et adapte-t-il sa réponse ? (attention). Qui prend la responsabilité de vérifier que le chatbot n’aggrave pas l’isolement du patient ? (prise en charge). Le chatbot est-il réellement compétent pour ce type de souffrance, ou donne-t-il des réponses génériques ? (soin effectif). Et surtout : a-t-on demandé aux patients eux-mêmes si l’outil leur fait du bien — ou s’il leur donne simplement l’impression de ne pas être seuls ? (réception du soin).

Pour la psychothérapie — où la relation est le soin — cette perspective semble incontournable. Le principisme pense l’agent moral comme un individu autonome face à des principes universels. L’éthique du care le pense comme un être en relation, dont la responsabilité émerge du lien avec autrui. Ne pas intégrer cette dimension dans le design d’outils de santé mentale, c’est construire un pont en ne calculant que la résistance des matériaux, sans se demander qui va le traverser et dans quel état.

Trois approches alternatives à connaître

L’embedded ethics n’est pas la seule réponse au problème. Voici trois approches complémentaires que tout professionnel intéressé par l’IA en psychothérapie devrait connaître :

Value-Sensitive Design (Batya Friedman)

Intégrer les valeurs humaines dans le design par des investigations conceptuelles, empiriques et techniques. Méthodologie très structurée, développée depuis 30 ans.

Éthique des vertus technologiques (Shannon Vallor)

Développer les bonnes dispositions morales (prudence, justice, courage) chez les développeurs eux-mêmes, plutôt que de se fier uniquement aux processus.

Régulation contraignante (EU AI Act)

Imposer des obligations légales de transparence, d’évaluation et de responsabilité. Seule approche ayant force de loi.

Aucune de ces approches n’est suffisante seule. C’est probablement une combinaison — embedded ethics + régulation + formation aux vertus + design participatif incluant les patients — qui produira les meilleurs résultats.

Questions ouvertes pour la recherche

L’article de McLennan et al. ouvre plus de questions qu’il n’en résout. Voici celles qui nous semblent les plus urgentes pour le champ de la psychothérapie :

- L’embedded ethics produit-elle des outils IA mesurablement plus sûrs ou plus éthiques ? Quels indicateurs utiliser ?

- Comment évaluer la « qualité éthique » d’un outil de santé mentale — au-delà de la conformité réglementaire ?

- Quels mécanismes institutionnels protègent l’éthicien intégré contre la pression commerciale ? Le modèle de la supervision clinique est-il transposable ?

- L’éthicien intégré développe-t-il une « capture cognitive » comparable au contre-transfert institutionnel ?

- L’éthique du care offre-t-elle un cadre plus adapté que le principisme pour le design d’outils de psychothérapie IA ?

- Comment intégrer la voix des patients — et pas seulement celle d’experts éthiciens — dans le processus de développement ?

- Les psychologues cliniciens ont-ils un rôle spécifique à jouer dans l’embedded ethics, distinct de celui des éthiciens professionnels ?

Notre position

L’embedded ethics est une avancée réelle dans la réflexion sur l’intégration de l’éthique dans le développement technologique. Le diagnostic est juste : les principes seuls ne suffisent pas, et le comité d’éthique qui intervient après le design est trop tardif. La proposition de placer des éthiciens dans les équipes, dès le début, est concrète et applicable.

Mais l’approche reste insuffisante si elle est la seule ligne de défense. Les rapports de pouvoir, la pression commerciale et le risque de capture cognitive ne se résolvent pas par la bonne volonté interdisciplinaire. Des mécanismes structurels — régulation, audits indépendants, inclusion des usagers — sont indispensables.

Pour la psychothérapie assistée par IA, nous retenons trois enseignements :

Exigez la transparence sur le processus de développement

Quand vous évaluez un outil IA pour votre pratique, demandez si des cliniciens et/ou des éthiciens ont participé à son développement — pas seulement à son marketing.

La compétence éthique n’est pas réservée aux éthiciens

En tant que psychologue clinicien, votre formation à la relation, au consentement éclairé, à la gestion des vulnérabilités et à l’auto-observation (supervision) vous donne une expertise éthique directement mobilisable pour évaluer ces outils.

Ne déléguez pas votre jugement

Ni aux principes éthiques abstraits, ni aux comités lointains, ni aux éthiciens intégrés que vous ne verrez jamais. La responsabilité éthique reste la vôtre — c’est à la fois une charge et une compétence.

Référence analysée : McLennan, S., Fiske, A., Tigard, D., Müller, R., Haddadin, S., & Buyx, A. (2022). Embedded ethics: a proposal for integrating ethics into the development of medical AI. BMC Medical Ethics, 23(6). https://doi.org/10.1186/s12910-022-00746-3

Lectures complémentaires :

- Mittelstadt, B. (2019). Principles alone cannot guarantee ethical AI. Nature Machine Intelligence, 1, 501-507. https://doi.org/10.1038/s42256-019-0114-4

- McLennan, S. et al. (2024). Embedded Ethics in Practice: A Toolbox for Integrating the Analysis of Ethical and Social Issues into Healthcare AI Research. Science and Engineering Ethics. https://doi.org/10.1007/s11948-024-00523-y

- Vallor, S. (2016). Technology and the Virtues: A Philosophical Guide to a Future Worth Wanting. Oxford University Press.

- Obermeyer, Z. et al. (2019). Dissecting racial bias in an algorithm used to manage the health of populations. Science, 366(6464), 447-453. https://doi.org/10.1126/science.aax2342

Concepts abordés

Définitions et concepts clés abordés dans cet article.