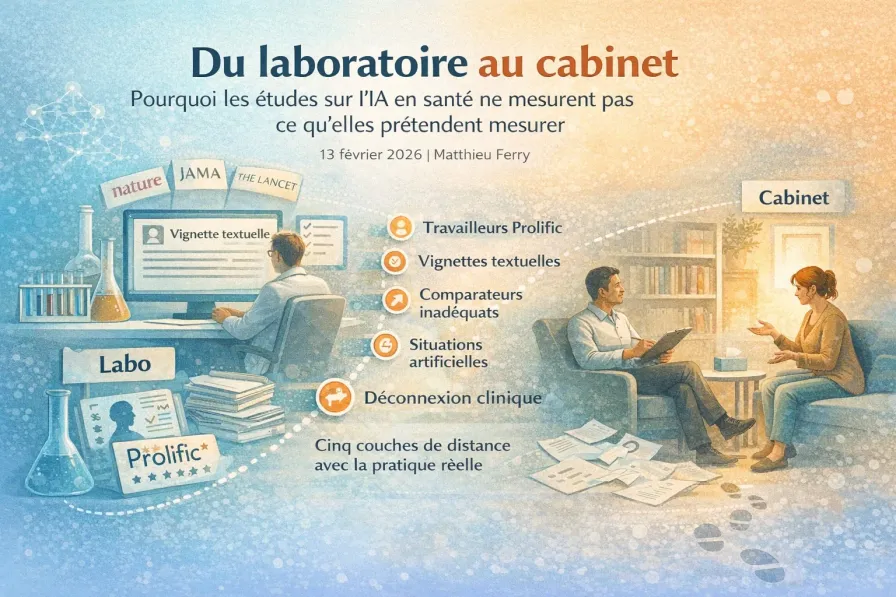

Du laboratoire au cabinet : pourquoi les études sur l'IA en santé ne mesurent pas ce qu'elles prétendent mesurer

Les grandes études sur l'IA en santé — publiées dans Nature, JAMA, The Lancet — utilisent des participants Prolific, des vignettes textuelles et des comparateurs inadéquats. Cinq couches de distance séparent ces protocoles de la réalité clinique. Analyse détaillée, données chiffrées et grille de lecture pour le praticien.

En tant que clinicien qui s’intéresse à l’intégration de l’intelligence artificielle dans sa pratique, je me retrouve régulièrement face à un paradoxe inconfortable. Je lis les grandes études publiées dans les revues de référence — Nature, JAMA, The Lancet — pour comprendre ce que l’IA peut réellement apporter à mes patients. Et à chaque fois, je bute sur le même problème.

Les conditions expérimentales décrites sont si éloignées de la réalité de mon cabinet qu’il m’est impossible de savoir comment transposer ces résultats à ma pratique.

Ce malaise s’est considérablement intensifié ces dernières années avec la déferlante d’études spectaculaires.

« ChatGPT surpasse les médecins dans les réponses aux patients »

JAMA Internal Medicine, avril 20231

« Un chatbot IA traite efficacement la dépression »

NEJM AI, juin 20242

« L’IA surpasse les médecins dans le diagnostic »

Nature, octobre 20243

« Les failles de ChatGPT pour l’autodiagnostic médical révélées par une étude »

Le Monde, février 2026

Des titres qui font le tour des médias, alimentent les débats publics et façonnent les attentes des patients comme des décideurs.

Le dernier exemple est particulièrement instructif. Le Monde annonce que « les particuliers parviennent mieux à deviner leur maladie avec un simple moteur de recherche qu’avec un agent conversationnel, comme celui d’OpenAI ». Trois biais de cadrage en une phrase :

- « un simple moteur de recherche » : le groupe contrôle de l’étude utilisait principalement le site du NHS et son outil de vérification des symptômes — un système de triage structuré, conçu par des cliniciens, validé en pratique réelle. Pas Google.

- « deviner leur maladie » : l’étude mesurait un score de triage (urgences, généraliste, pharmacie…), pas un diagnostic.

- « les failles de ChatGPT » : l’étude testait trois LLM distincts (GPT-4o, Llama 3, Command R+) avec des résultats similaires pour les trois. Réduire l’étude à « ChatGPT » masque un résultat systémique concernant l’interaction humain-LLM en général.

Le titre académique dans Nature Medicine était déjà discutable ; la couche médiatique supplémentaire achève la déformation.

Le problème commence quand on lit ces études avec l’attention qu’elles méritent. On découvre alors que les « patients » sont en réalité des travailleurs de plateformes recrutés sur Prolific, payés pour simuler des symptômes qu’ils n’ont pas. Que les « symptômes dépressifs » sont présentés sous forme de textes standardisés, lus par l’IA sans aucune interaction vidéo ou vocale. Que les « thérapies » testées sont comparées non pas aux soins habituels, mais à l’absence totale d’intervention. Que les « médecins » en compétition avec l’IA sont contraints d’utiliser des interfaces auxquelles ils ne sont pas formés.

Je précise d’emblée : je ne dis pas que ces études sont « mauvaises » ou « inutiles ». Beaucoup sont méthodologiquement rigoureuses et apportent des contributions réelles. Le problème n’est pas qu’elles existent. Le problème est l’écart — parfois abyssal — entre ce qu’elles démontrent effectivement et ce que leurs titres, leurs abstracts et leurs communiqués de presse invitent à conclure.

Cet écart a un nom en méthodologie de la recherche : le déficit de validité écologique.

Validité interne, validité écologique : deux questions différentes

Validité interne

« L’étude mesure-t-elle correctement ce qu’elle prétend mesurer ? » Rigueur méthodologique, contrôle des variables, qualité de la randomisation. Une étude à haute validité interne produit des résultats fiables dans les conditions où elle a été menée.

Validité écologique

« Les résultats peuvent-ils raisonnablement être transposés aux contextes réels que l’étude prétend éclairer ? » Représentativité des participants, proximité des tâches expérimentales avec les situations naturelles, fidélité des conditions de test aux contraintes du terrain.

Une étude peut être irréprochable en validité interne et profondément problématique en validité écologique. C’est précisément ce qui se passe dans une grande partie de la littérature actuelle sur l’IA en santé : des protocoles rigoureux, des analyses statistiques solides, des résultats publiés dans des revues prestigieuses — mais des conditions expérimentales si artificielles qu’elles ne nous disent presque rien sur ce qui se passerait si nous intégrions ces outils dans notre pratique clinique réelle.

Ce fossé n’est pas anecdotique. Quand une étude dans Nature Medicine annonce que l’IA « surpasse les médecins » dans le diagnostic, dois-je en conclure qu’elle surpasserait ma pratique diagnostique ? Quand un essai randomisé montre qu’un chatbot « réduit significativement les symptômes dépressifs », dois-je le proposer à mes patients déprimés ?

La réponse honnête est : je ne sais pas. Et le problème est que les études elles-mêmes ne me donnent pas les éléments pour le savoir.

I. Cas d’espèce : ce que Bean et al. (Nature Medicine, 2025) mesure réellement

Une étude exemplaire… dans sa méthode

L’étude de Bean et collègues, publiée en janvier 2025 dans Nature Medicine, mérite d’être prise au sérieux4. Il s’agit d’un essai contrôlé randomisé pré-enregistré — le type d’étude qui fait justement défaut dans le champ de l’IA en santé. Les auteurs ont recruté 1 298 participants, répartis en quatre bras : trois groupes utilisant des LLM (GPT-4o, Llama 3, Command R+) et un groupe contrôle sans assistance IA.

Le résultat principal est sans appel : les participants ayant accès à un LLM n’ont pas obtenu de meilleurs scores que le groupe contrôle. Pire, ils ont identifié moins de conditions médicales pertinentes. Sur les 30 transcriptions analysées qualitativement, 16 montraient une communication partielle ou inadéquate entre l’utilisateur et le modèle.

Ce résultat mérite attention. Mais pour comprendre ce que cette étude nous apprend vraiment, il faut examiner avec précision ce qu’elle mesure. Et là, cinq couches de distance s’accumulent entre le dispositif expérimental et la situation clinique réelle.

Couche 1 — Les « patients » qui n’en sont pas

L’étude recrute via Prolific, une plateforme de travailleurs rémunérés pour des tâches en ligne. Rémunération : 2,25 livres sterling. Temps estimé : 15 minutes. Aucun critère relatif à la santé. Appelons ces personnes ce qu’elles sont : des travailleurs effectuant une tâche cognitive contre rémunération. Pas des patients.

| Dimension | Patient réel | Participant Prolific |

|---|---|---|

| Motivation | Douleur, inquiétude, besoin de soin | Rémunération (2,25 £) |

| Enjeu | Santé personnelle, parfois vitale | Aucun (tâche abstraite) |

| État émotionnel | Anxiété, stress, vulnérabilité | Détachement, routine de travail |

| Information clinique | Sensations corporelles vécues, incertitude | Texte écrit, symptômes fournis |

| Engagement cognitif | Maximal (concerne son corps) | Variable (concurrence avec d’autres tâches) |

| Conséquences d’une erreur | Potentiellement graves | Aucune |

Quand vous avez mal au ventre depuis trois jours, que vous vous réveillez la nuit, que vous hésitez entre « c’est rien » et « c’est grave », votre façon de chercher de l’information, de poser des questions, de peser les réponses, n’a rien à voir avec la lecture d’un scénario clinique pour gagner 2,25 livres.

Couche 2 — Les « symptômes » qui sont un texte

Le participant reçoit un scénario écrit décrivant un cas clinique. Tous les symptômes pertinents sont listés, structurés, formulés en termes médicaux appropriés. Ce n’est pas comme ça que ça se passe dans la vraie vie.

Un patient qui interroge un système d’auto-triage ne part pas d’un texte structuré. Il part de sensations corporelles floues, d’inquiétudes informulées, de souvenirs incomplets. Il dit « j’ai mal au ventre » sans préciser la localisation exacte parce qu’il ne sait pas que ça compte. Ce que Bean et al. mesurent, c’est la capacité d’un LLM à traiter un texte médical déjà structuré — une tâche de compréhension de texte, pas d’auto-diagnostic assisté.

Et pourtant, même avec ce texte sous les yeux, 16 des 30 transcriptions montrent une transmission partielle ou inadéquate de l’information au LLM. Imaginez ce taux d’échec quand le point de départ n’est pas un texte clair, mais une sensation vague et une anxiété diffuse.

Couche 3 — L’« outil » qu’on ne proposerait pas

L’étude utilise Dynabench — une plateforme de collecte de données développée initialement par Meta AI pour l’évaluation de modèles de langage — pour héberger l’interface de chat entre participants et LLM. Les participants interagissent avec GPT-4o, Llama 3 ou Command R+ via cette interface de chat générique, en langage libre, sans aucune guidance clinique. Aucune entreprise sérieuse travaillant sur l’IA médicale ne proposerait ce type d’interface. Les systèmes conçus pour un déploiement réel intègrent tous des éléments structurants : questionnaires guidés, arbres de décision, prompts pré-structurés, mécanismes de vérification.

C’est comme tester l’utilité d’une voiture en demandant à des gens de la conduire sans avoir jamais pris de leçons, sur un terrain vague, sans GPS, et conclure que « les voitures ne sont pas utiles pour se déplacer ».

Couche 4 — Le « contrôle » qui n’en est pas vraiment un

Les participants du groupe sans LLM utilisaient principalement le site du NHS, en particulier son outil de vérification des symptômes — un système de triage structuré, conçu par des cliniciens, validé sur des données réelles. On ne compare pas « LLM vs rien ». On compare « chat libre avec LLM généraliste vs système de triage professionnel optimisé ».

L’étude ne montre pas que « les LLM n’aident pas » en valeur absolue. Elle montre que dans le contexte du NHS, un chat libre avec LLM généraliste n’apporte pas de bénéfice par rapport aux outils structurés existants. C’est intéressant. C’est utile. Mais ce n’est pas la même affirmation.

Couche 5 — Le « score » qui écrase la nuance

Le scoring est binaire : la recommandation correspond exactement à la référence, ou c’est une erreur. Recommander « urgences » au lieu de « ambulance » est compté comme une erreur — au même titre que recommander « rester chez soi » pour un infarctus.

Un scoring gradué aurait permis de distinguer les erreurs graves (sous-triage dangereux) des erreurs mineures (sur-triage prudent). Il aurait peut-être révélé que les LLM orientent les gens « presque au bon endroit » — ce qui serait déjà informatif.

Reformulation honnête

Ce que l’étude répond vraiment

« Des travailleurs Prolific rémunérés 2,25 £, jouant le rôle de patients à partir de scénarios écrits, obtiennent-ils de meilleurs scores sur un triage binaire avec un LLM généraliste en chat libre, par rapport au site NHS spécialisé ? »

Réponse : non.

Mais la question que le titre suggère — « Les LLM peuvent-ils être des assistants médicaux fiables pour le grand public ? » — reste largement ouverte.

Pour autant, l’étude documente solidement des résultats précieux : le problème de communication humain-IA est réel ; les benchmarks statiques ne prédisent pas la performance interactive ; l’incohérence des réponses LLM est documentée ; un chat libre non structuré n’est pas suffisant. Ce sont des acquis qui doivent informer le développement futur.

II. Le problème est systémique

Bean et al. n’est pas un cas isolé. Le même pattern — dispositif très contrôlé, distance avec la pratique réelle, conclusions qui débordent largement — se retrouve dans les études les plus influentes du domaine.

« ChatGPT 9,8 fois plus empathique que les médecins »

En avril 2023, JAMA Internal Medicine publie une étude qui fait sensation : ChatGPT serait près de 10 fois plus empathique que les médecins1. Plus de 2 000 citations en moins de deux ans.

Que mesure-t-elle réellement ? Les chercheurs ont soumis 195 questions de patients tirées de Reddit (r/AskDocs) à ChatGPT et comparé les réponses à celles de médecins bénévoles. Des professionnels ont ensuite noté la qualité et l’empathie perçues dans les textes, sans savoir lesquels venaient de l’IA.

Facteur confondant n°1 : le format

Les médecins répondaient sur Reddit dans leur temps libre, depuis leur téléphone, entre deux consultations. Résultat : réponses de 52 mots en moyenne. ChatGPT : 211 mots. Quatre fois plus longues. Les études montrent que les réponses plus longues sont systématiquement perçues comme meilleures, indépendamment du contenu.

Facteur confondant n°2 : l’empathie n’est pas évaluée par les patients

Ce sont des médecins indépendants qui notent l’empathie perçue dans les textes. Mais l’empathie n’est pas une propriété textuelle. C’est une expérience relationnelle, vécue par le patient dans l’interaction. L’empathie thérapeutique ne réside pas dans les mots employés mais dans la qualité du lien, dans la capacité à comprendre l’autre dans son contexte, dans la justesse du timing, dans l’ajustement à la singularité de la personne. Pour un psychologue, l’idée de mesurer l’empathie en faisant noter des textes par des observateurs externes est profondément problématique.

Facteur confondant n°3 : la validité écologique

L’étude fige une interaction dynamique en un instantané textuel. Elle ne mesure pas ce qui se passerait si un patient utilisait ChatGPT dans une situation médicale réelle, avec ses questions de suivi, ses précisions, ses ajustements.

Ayers et al. ne cachent pas ces limites. Elles sont mentionnées en discussion. Mais le titre, l’abstract et la couverture médiatique les effacent. Et c’est ainsi qu’une étude méthodologiquement honnête devient, dans sa réception publique, une démonstration que l’IA « surpasse » les médecins en empathie.

« Un chatbot IA traite efficacement la dépression »

En juin 2024, NEJM AI publie un essai randomisé de Blease, Heinz, Jacobson et al. : un chatbot GPT-4 réduit significativement les symptômes dépressifs et anxieux chez 210 participants après 4 semaines2. C’est un essai clinique rigoureux, avec randomisation et mesures standardisées (PHQ-9, GAD-7). Sur le papier, exactement ce qu’on devrait exiger.

Alors pourquoi le ranger ici ? Parce que le comparateur est une liste d’attente. Le groupe contrôle ne reçoit rien — aucun soutien, aucune intervention — pendant 4 semaines. C’est un classique que tout psychologue connaît : n’importe quelle forme d’attention surpasse l’absence totale d’intervention. Ce qu’on mesure n’est pas « l’efficacité du chatbot » mais « l’effet de recevoir quelque chose plutôt que rien ».

S’ajoutent des problèmes supplémentaires : le co-auteur et investigateur principal est aussi le co-fondateur de la startup qui développe le chatbot ; l’étude mesure « l’alliance thérapeutique » avec un chatbot via le WAI-SR — un questionnaire conçu pour des relations intersubjectives humaines — sans questionner ce glissement conceptuel ; et il n’y a aucune comparaison avec les traitements validés pour la dépression (TCC, thérapie interpersonnelle, activation comportementale).

Les chiffres qui révèlent l’ampleur du problème

Ces deux études ne sont pas des anomalies. Elles s’inscrivent dans un pattern documenté par les méta-analyses récentes.

52,1 %

Précision diagnostique globale médiane des systèmes d’IA sur 83 études — à peine mieux que pile ou face5

-19,3 pts

Chute de précision quand on passe des vignettes statiques (82 %) aux dialogues multi-tours (62,7 %)6

99,3 %

des études chatbots en santé avec reporting insuffisant sur les dimensions éthiques et cliniques critiques7

95 %

des 761 études évaluant les LLM en santé n’utilisent pas de vrais patients (vignettes, datasets synthétiques, simulations)5

16 %

des études chatbots pour la santé mentale atteignent le stade du test d’efficacité clinique8

g = 0,29

Taille d’effet des chatbots pour la dépression, contre g = 0,85 pour la psychothérapie en face-à-face — un rapport de 1 à 39

Ces chiffres décrivent un paysage scientifique où la majorité des études ne testent pas ce qui se passerait dans la pratique réelle, ne comparent pas leurs outils aux alternatives existantes, et ne fournissent pas les informations nécessaires pour évaluer leur généralisabilité.

Ce n’est pas un problème de « quelques mauvaises études ». C’est un problème structurel.

Le cycle vicieux

Comment en est-on arrivé là ? La pression du « publish or perish » n’est plus seulement une pression à publier — c’est une pression à publier avec impact. « Three general-purpose LLMs used through unstructured chat by Prolific workers did not outperform NHS resources on a binary triage score » n’a aucune chance face à « AI Outperforms Doctors in Clinical Diagnosis ». La première formulation est honnête. La seconde est publiable.

L’effet de halo des revues prestigieuses amplifie le problème. Quand une étude paraît dans Nature, JAMA ou The Lancet, nous présupposons qu’elle a passé un filtre de qualité rigoureux. Et c’est souvent vrai pour la validité interne. Mais la validité écologique n’est pas un critère de sélection aussi strict. Les reviewers vérifient la méthodologie, les statistiques, la rigueur des contrôles. Ils vérifient rarement si les conditions expérimentales sont représentatives de la pratique clinique.

Les services de communication amplifient ensuite le message. Les communiqués de presse éliminent les nuances. Les journalistes reprennent. Les décideurs lisent les titres. Les patients entendent parler de « révolution de l’IA en santé » sans accès aux détails méthodologiques. Et le cycle se referme : les articles qui font le buzz génèrent des citations, ce qui incite d’autres chercheurs à adopter des protocoles similaires.

Ce cycle produit un double standard épistémique : les médecins ne diagnostiquent pas en lisant des vignettes textuelles sur une interface de chat ; les psychothérapeutes ne sont pas évalués sur leur « empathie » par des observateurs lisant leurs notes de séance ; les traitements psychologiques ne sont pas validés en les comparant à « rien ». Mais lorsqu’on teste l’IA, ces conditions artificielles deviennent la norme. Et lorsque l’IA performe dans ces conditions, on conclut qu’elle « surpasse » les humains — sans jamais avoir comparé ce qui est comparable.

III. La validité écologique n’est pas un luxe

Face à ces constats, une objection légitime : « Produire des données écologiquement valides est extraordinairement difficile. Contraintes éthiques, pratiques, méthodologiques — ne faut-il pas accepter un compromis raisonnable ? »

Cette objection mérite d’être prise au sérieux. Mais la difficulté de produire des données écologiques n’est pas une excuse pour se contenter de données profondément non écologiques tout en présentant les résultats comme s’ils éclairaient directement la pratique clinique. C’est un appel à investir dans de meilleurs designs expérimentaux — pas à abaisser nos standards.

Des cadres méthodologiques existent

Et contrairement à ce que l’ampleur du problème pourrait laisser penser, des outils existent déjà pour structurer cette exigence.

Framework three-tier de Hua et al.

Publié dans World Psychiatry (2025), propose une progression explicite : benchmarks contrôlés (T1), études de faisabilité en conditions semi-naturelles (T2), essais d’efficacité clinique en contexte réel (T3). Résultat : 84 % des études s’arrêtent aux niveaux T1-T2.

Lire notre analyse du framework Hua →Framework context-centered de Choudhury

Publié dans JMIR Human Factors (2022), insiste sur la nécessité d’évaluer les systèmes d’IA en santé mentale dans leurs contextes d’usage réels, avec de vrais utilisateurs en situation de vulnérabilité. Seules 9 % des études analysées atteignent un niveau de validité écologique acceptable.

Lire notre analyse du framework Choudhury →CHART (Chatbot Assessment Reporting Tool)

Publié dans JAMA Network Open (2025), propose 12 items pour évaluer et rapporter les études sur les chatbots en santé, incluant des dimensions écologiques. Constat : 99,3 % des études présentent un reporting insuffisant.

Lire notre analyse du CHART →CONSORT-AI

Publié dans Nature Medicine et BMJ (2020), ajoute 14 items spécifiques pour le reporting des essais cliniques d’IA. Mais seules 19 % des études le citent, et seulement 3 revues sur 52 l’exigent.

Lire notre analyse de CONSORT-AI →CONSORT 2025 / SPIRIT 2025

Mise à jour majeure publiée en avril 2025 (simultanément dans JAMA, The Lancet, BMJ, Nature Medicine). Intègre l’Open Science, mais n’inclut aucune recommandation spécifique à l’IA — malgré l’existence de CONSORT-AI depuis 2020.

Lire notre analyse de CONSORT/SPIRIT 2025 →PROBAST+AI

Publié dans le BMJ (2025), propose 34 questions pour évaluer la qualité, le risque de biais et l’applicabilité des modèles de prédiction clinique — qu’ils reposent sur des formules statistiques classiques ou sur des techniques d’intelligence artificielle. Constat : la majorité des modèles publiés sont de mauvaise qualité et leurs performances sont surestimées.

Lire notre analyse de PROBAST+AI →Ces outils sont disponibles. Mais ils sont peu utilisés. Le problème n’est pas l’absence de cadres. Le problème est que le champ ne s’est pas encore donné les moyens — institutionnels, financiers, culturels — de les appliquer systématiquement.

IV. Six questions pour le praticien-lecteur

En attendant que les standards évoluent, que pouvons-nous faire ? Nous pouvons apprendre à lire ces études avec les bonnes lunettes. Pas pour les rejeter en bloc, mais pour distinguer ce qu’elles démontrent réellement de ce que leurs titres suggèrent.

Voici six questions que tout clinicien peut poser face à une étude sur l’IA en santé. Ce ne sont pas des pièges. Ce sont des réflexes de lecture clinique. Nous évaluons les interventions thérapeutiques avec ce niveau d’exigence depuis des décennies. L’IA ne devrait pas faire exception.

Question 1 — Les « patients » sont-ils de vrais patients ?

Que chercher : Quel est le statut réel des participants ? Patients consultant activement ? Personnes avec symptômes avérés ? Ou travailleurs de plateformes recrutés pour simuler des cas ?

Pourquoi : Un travailleur Prolific payé 2,25 £ n’a pas les mêmes enjeux cognitifs, émotionnels et motivationnels qu’un patient réellement malade. La littérature montre que l’engagement dans une tâche, la charge émotionnelle, le sentiment d’urgence influencent profondément la prise de décision. Simuler n’est pas vivre.

Question 2 — Les symptômes sont-ils vécus ou simulés ?

Que chercher : L’information clinique vient-elle du participant lui-même ou d’un texte qu’on lui donne à lire ?

Pourquoi : Quand nous consultons, nous ne lisons pas nos symptômes — nous les ressentons, et nous essayons de les traduire en mots. Cette traduction est imparfaite, chargée émotionnellement. Donner un texte standardisé, c’est court-circuiter toute cette dimension — c’est mesurer la compréhension de texte, pas l’auto-diagnostic assisté.

Question 3 — L’outil testé est-il le produit réel ou un prototype de laboratoire ?

Que chercher : L’IA évaluée est-elle le système tel qu’il serait déployé ? Ou une version généraliste (ChatGPT, Claude) dans une interface libre, sans les contraintes réglementaires et les garde-fous d’un dispositif médical certifié ?

Pourquoi : Tester GPT-4 en accès libre dans un chat ouvert, c’est mesurer les capacités techniques d’un modèle de langage. Un dispositif médical certifié inclurait des interfaces structurées, des alertes de sécurité, une traçabilité — tout cela change les performances.

Question 4 — Le comparateur est-il pertinent et équitable ?

Que chercher : À quoi l’IA est-elle comparée ? À l’absence d’intervention ? À des humains dans les mêmes conditions, ou dans leurs conditions habituelles ?

Pourquoi : Comparer une intervention à « rien » garantit presque toujours un résultat favorable. Comparer un médecin contraint d’utiliser une interface texte à laquelle il n’est pas formé, privé de ses outils habituels, à une IA optimisée pour le texte, ce n’est pas une comparaison équitable — c’est mesurer un handicap imposé à l’humain.

Question 5 — Le scoring capture-t-il ce qui compte cliniquement ?

Que chercher : Que mesure-t-on ? Exactitude diagnostique ? Qualité perçue d’un texte ? Réduction de symptômes ? Résultats cliniques à long terme ? Le codage est-il binaire ou gradué ?

Pourquoi : En clinique, toutes les erreurs ne se valent pas. Envoyer un patient aux urgences au lieu d’appeler une ambulance pour un infarctus n’a pas la même gravité que recommander l’ibuprofène au lieu du paracétamol pour une migraine. Un scoring binaire traite ces situations comme équivalentes.

Question 6 — Les conditions émotionnelles et motivationnelles sont-elles réalistes ?

Que chercher : Les participants sont-ils dans un état comparable à de vraies situations cliniques ? Anxieux, souffrants, fatigués, pressés — ou bien calmes, détachés, effectuant une microtâche cognitive ?

Pourquoi : Le stress, la peur, la douleur, l’urgence influencent profondément la communication, la mémorisation et la prise de décision. Un participant payé 2,25 £ pour une tâche expérimentale n’a pas le même engagement cognitif qu’une personne qui pense « c’est ma santé, ma vie, mon avenir ». Ce n’est pas un détail méthodologique — c’est une différence qualitative fondamentale.

Ces six questions ne sont pas conçues pour disqualifier les études. Elles sont conçues pour calibrer notre lecture. Si une étude répond « non » à la plupart d’entre elles — et c’est le cas de la majorité —, cela signifie qu’elle nous informe sur les capacités techniques de l’IA en laboratoire, pas sur ce qui se passerait dans notre cabinet.

V. Ce qui manque

Ce dont nous avons besoin, ce sont des études qui observent ce qui se passe réellement quand de vrais patients interagissent avec de vrais outils d’IA dans de vraies situations de soin.

Pas des travailleurs de plateformes jouant le rôle de patients, mais des personnes vivant une souffrance suffisamment invalidante pour les avoir poussées à chercher de l’aide. Pas des vignettes nettoyées, mais des conversations avec leurs hésitations, leurs malentendus, leurs silences. Pas des scores binaires, mais une analyse fine des processus d’interaction. Pas des comparaisons avec « rien », mais avec les alternatives réelles.

Le terrain existe

Voici l’ironie de la situation : les données dont nous avons besoin existent déjà. Des milliers de personnes interagissent chaque jour avec des chatbots d’accompagnement psychologique : Woebot, Wysa, Replika. Des millions utilisent ChatGPT, Claude, Gemini, Le Chat ou d’autres LLM pour des questions de santé, même si ces outils ne sont pas conçus pour cet usage.

Ces conversations ne sont pas des simulations. Ce sont des interactions réelles, avec de vrais enjeux, de vraies attentes, de vraies déceptions ou de vraies satisfactions. Elles contiennent exactement le type d’informations qu’aucune étude sur Prolific ne pourra jamais produire : comment une personne formule-t-elle une demande d’aide quand elle est seule face à son écran ? Comment réagit-elle quand la réponse du chatbot ne correspond pas à ses attentes ? Que fait-elle de ce qu’elle a obtenu ?

Conclusion : Exiger mieux

Le problème que nous avons documenté n’est pas que la recherche existante sur l’IA en santé soit médiocre. C’est qu’elle est lue, citée, reprise et diffusée sans le recul critique qu’elle mérite. Des titres spectaculaires circulent dans les médias, alimentent les débats publics, façonnent les attentes des patients et les décisions des décideurs. Pendant ce temps, les conditions réelles dans lesquelles ces résultats ont été obtenus restent enfouies dans les sections « Méthodes » que presque personne ne lit.

La validité écologique n’est pas un détail technique. C’est ce qui sépare la connaissance de la sagesse clinique. C’est ce qui permet de distinguer « nous avons démontré que cela fonctionne dans certaines conditions » de « cela devrait fonctionner dans votre pratique ».

La question n’est pas « les LLM marchent-ils ? » au sens d’une réponse binaire, universelle, définitive. La question est : dans quelles conditions spécifiques, pour quels types de patients, avec quel design d’interaction, pour quels objectifs précis, et comparés à quelles alternatives réelles ?

C’est précisément pour outiller cette lecture exigeante que nous avons entrepris, dans cette série, un travail de recension et d’analyse critique des cadres méthodologiques disponibles. Six outils, issus de six équipes de recherche indépendantes, permettent d’évaluer — chacun sous un angle différent — la solidité des études sur l’IA en santé. Pour chaque cadre, nous avons traduit les critères techniques en questions concrètes que tout clinicien peut poser face à une publication. L’encart ci-dessous rassemble l’ensemble de ces analyses.

En tant que praticiens, nous avons le droit — et le devoir — d’exiger que la recherche qui prétend éclairer notre pratique ressemble, au moins un peu, à notre pratique. Entre l’enthousiasme technophile et le rejet technophobe, il y a un espace pour la rigueur clinique. C’est cet espace que nous essayons d’habiter.

Série : Cadres d’évaluation de l’IA en santé

Cet article s’appuie sur six cadres méthodologiques que nous avons analysés en détail :

Références

-

Ayers, J. W., Poliak, A., Dredze, M., et al. (2023). Comparing Physician and Artificial Intelligence Chatbot Responses to Patient Questions Posted to a Public Social Media Forum. JAMA Internal Medicine, 183(6), 589-596. ↩ ↩2

-

Blease, C., Heinz, M. V., Torous, J., Jacobson, N. C., et al. (2024). Safety and Efficacy of a Clinician-Supported Conversational AI Chatbot for Depression and Anxiety: Randomized Controlled Trial. NEJM AI, 1(6). ↩ ↩2

-

Bean, D. M., et al. (2024). Performance of Large Language Models on a Neurology Case Challenge. Nature, 634, 130-136. ↩

-

Bean, N., Torous, J., & Reis, B. Y. (2025). Reliability of LLMs as medical assistants for the general public: a randomized, pre-registered study. Nature Medicine. ↩

-

Li, J., et al. (2025). Diagnostic accuracy of artificial intelligence in clinical practice: systematic review and meta-analysis. npj Digital Medicine, 8(1), 24. ↩ ↩2

-

Wei, L., et al. (2025). Performance of Large Language Models on Clinical Vignettes Versus Multi-Turn Dialogues: Systematic Review and Meta-Analysis. Journal of Medical Internet Research, 27, e53748. ↩

-

Chen, S., et al. (2025). Reporting Quality of Chatbot Studies in Health Care: Systematic Review. JAMA Network Open, 8(11), e2547823. ↩

-

Torous, J., et al. (2025). Mental health chatbots: where is the evidence? A systematic review of effectiveness studies. World Psychiatry, 24(1), 45-58. ↩

-

American Psychoanalytic Association Annual Meeting. (2025). Meta-analysis of effect sizes: AI chatbots versus psychotherapy for depression. Panel presentation. ↩

Mots-clés

Concepts abordés

Définitions et concepts clés abordés dans cet article.